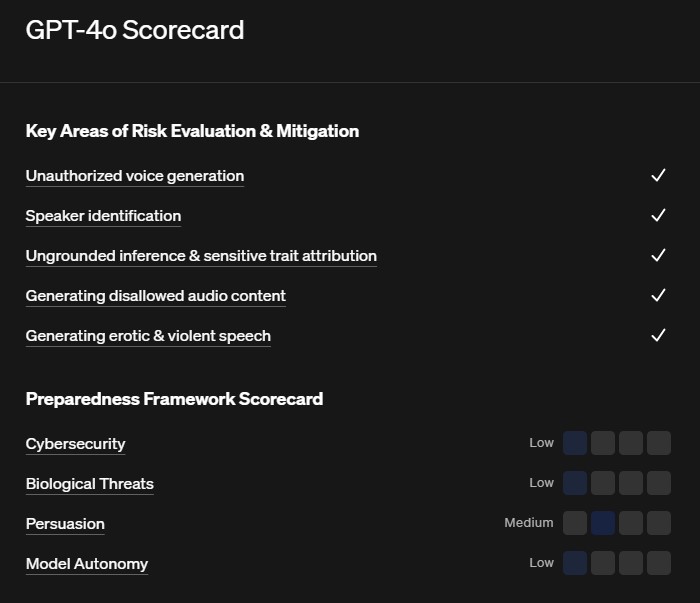

Openai彼は「GPT-4Oシステムカード」Publicを作成しました。これは、最新の人工知能モデルの開始前に行われたリスクの安全対策と評価を示す研究文書です。そして、Openaiの評価によると、GPT-4oには「中リスク」があります。この分類は、コンピューターセキュリティ、生物学的脅威、説得、モデルの自律性の4つのリスクカテゴリ間の最高の評価から派生しています。

いくつかのGPT-4o執筆サンプルが、人間によって書かれたテキストと比較して読者を説得する方が効果的であることが証明されている説得を除いて、すべてのカテゴリは低リスクと見なされています。

このリスク評価の公開は、Openaiにとって重要な瞬間に行われます。同社は、自社の従業員と米国上院議員の両方による、安全基準に関する継続的な批判の対象となっています。実際、米国大統領選挙の近くにこのような強力なマルチモーダルモデルの立ち上げは、攻撃された俳優による偽情報または悪意のある使用の偶発的な拡散の潜在的なリスクについての懸念を引き起こします。 Openiは、これらのテストの公開を通じて虐待を防ぐという彼のコミットメントを実証したいと考えています。

Openiは、モデルのトレーニングデータだけでなく、安全テストについても、Openiがより透明性があるように多数のリクエストが提起されています。 Openaiが拠点を置いているカリフォルニアでは、スコットウィナー上院議員は、大規模な言語モデルを規制する法案に取り組んでおり、IAの有害な使用の場合に企業が法的に責任を負わせる制限を導入しています。

要するに、GPT-4Oシステムカードの公開は、透明性に対するOpenaiのコミットメントを示すことを目的とした文章ですが、モデルのリスクを客観的に評価する会社の能力に関する疑問も提起します。 AIのより大きな規制に対する圧力の高まりは、Openiiなどの企業がモデルを開発およびリリースする方法に大きな変化につながる可能性があります。

どう思いますか? SO -Caledの人工知能にもっと注意が必要ですか?以下のコメントで教えてください。